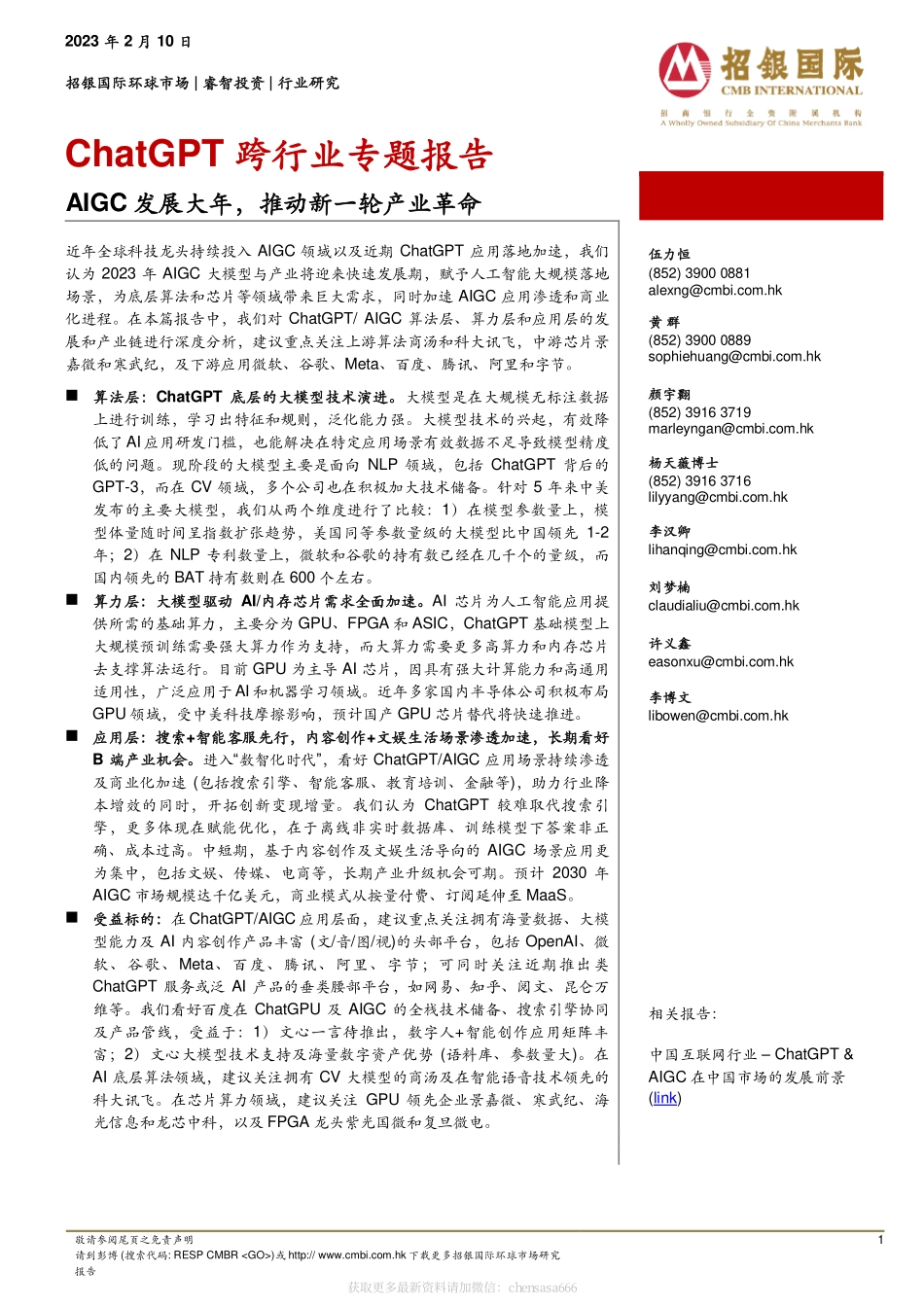

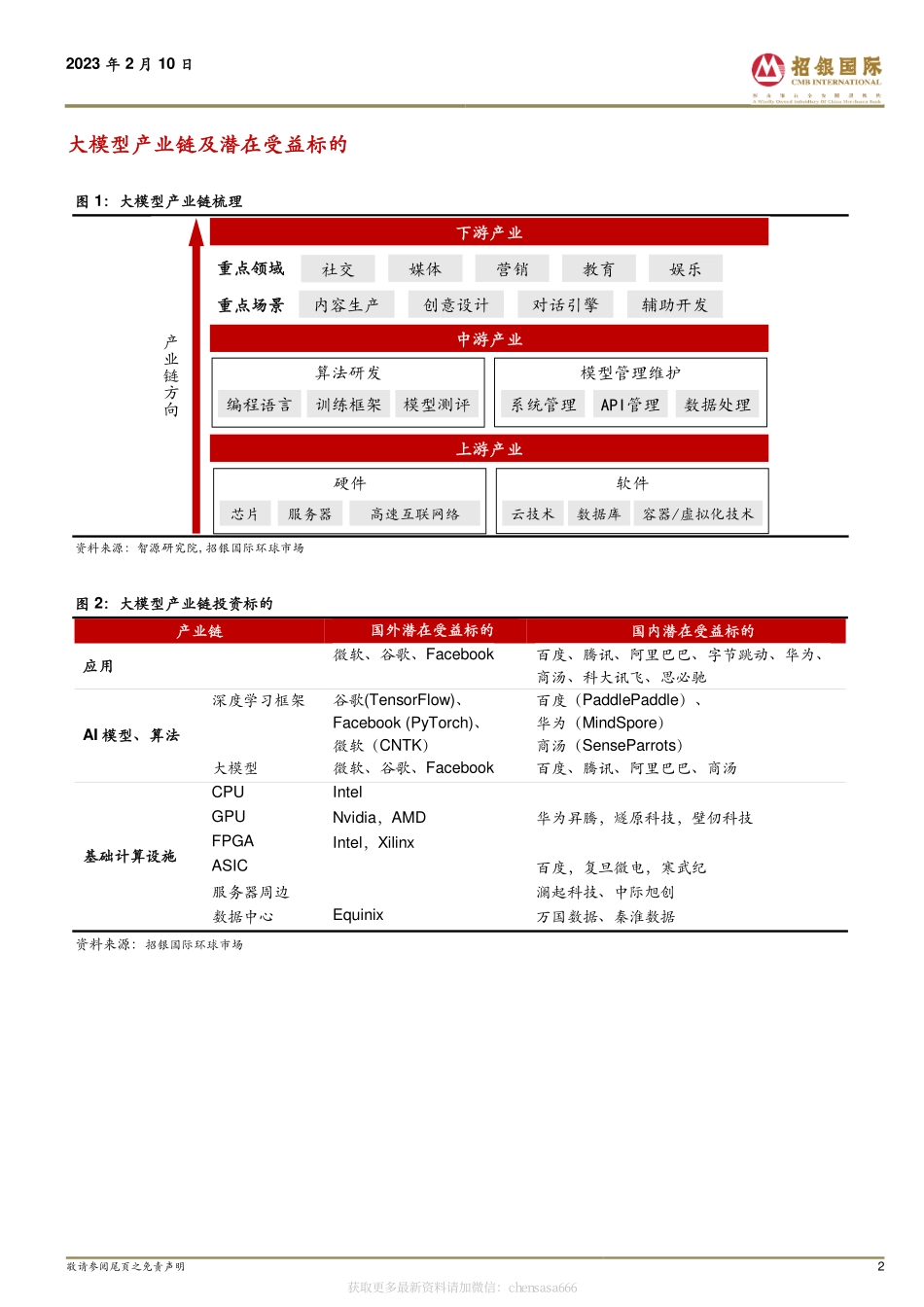

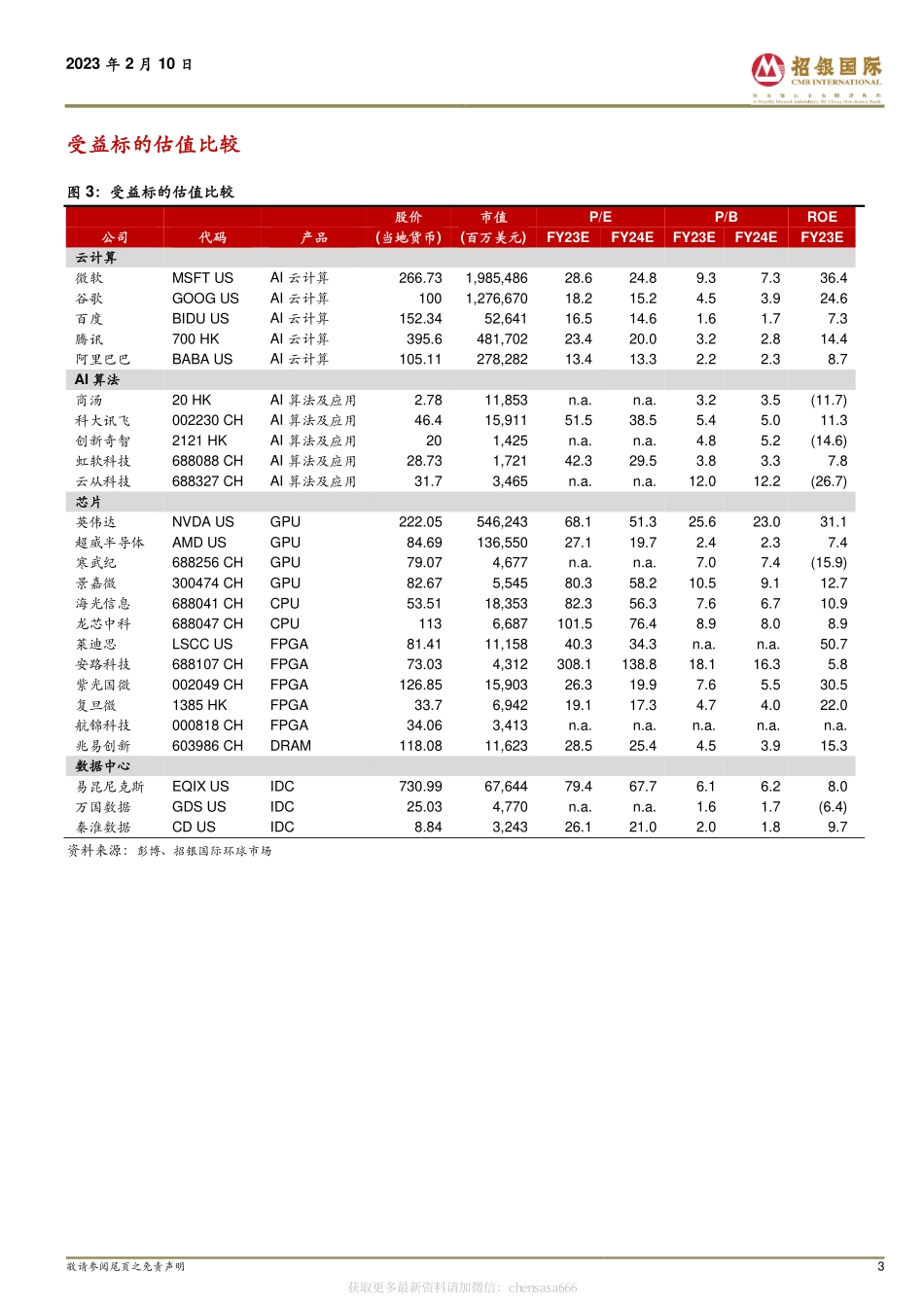

敬请参阅尾页之免责声明请到彭博(搜索代码:RESPCMBR)或http://www.cmbi.com.hk下载更多招银国际环球市场研究报告1\\\\\\\\\\\2023年2月10日招银国际环球市场|睿智投资|行业研究ChatGPT跨行业专题报告AIGC发展大年,推动新一轮产业革命近年全球科技龙头持续投入AIGC领域以及近期ChatGPT应用落地加速,我们认为2023年AIGC大模型与产业将迎来快速发展期,赋予人工智能大规模落地场景,为底层算法和芯片等领域带来巨大需求,同时加速AIGC应用渗透和商业化进程。在本篇报告中,我们对ChatGPT/AIGC算法层、算力层和应用层的发展和产业链进行深度分析,建议重点关注上游算法商汤和科大讯飞,中游芯片景嘉微和寒武纪,及下游应用微软、谷歌、Meta、百度、腾讯、阿里和字节。算法层:ChatGPT底层的大模型技术演进。大模型是在大规模无标注数据上进行训练,学习出特征和规则,泛化能力强。大模型技术的兴起,有效降低了AI应用研发门槛,也能解决在特定应用场景有效数据不足导致模型精度低的问题。现阶段的大模型主要是面向NLP领域,包括ChatGPT背后的GPT-3,而在CV领域,多个公司也在积极加大技术储备。针对5年来中美发布的主要大模型,我们从两个维度进行了比较:1)在模型参数量上,模型体量随时间呈指数扩张趋势,美国同等参数量级的大模型比中国领先1-2年;2)在NLP专利数量上,微软和谷歌的持有数已经在几千个的量级,而国内领先的BAT持有数则在600个左右。算力层:大模型驱动AI/内存芯片需求全面加速。AI芯片为人工智能应用提供所需的基础算力,主要分为GPU、FPGA和ASIC,ChatGPT基础模型上大规模预训练需要强大算力作为支持,而大算力需要更多高算力和内存芯片去支撑算法运行。目前GPU为主导AI芯片,因具有强大计算能力和高通用适用性,广泛应用于AI和机器学习领域。近年多家国内半导体公司积极布局GPU领域,受中美科技摩擦影响,预计国产GPU芯片替代将快速推进。应用层:搜索+智能客服先行,内容创作+文娱生活场景渗透加速,长期看好B端产业机会。进入“数智化时代”,看好ChatGPT/AIGC应用场景持续渗透及商业化加速(包括搜索引擎、智能客服、教育培训、金融等),助力行业降本增效的同时,开拓创新变现增量。我们认为ChatGPT较难取代搜索引擎,更多体现在赋能优化,在于离线非实时数据库、训练模型下答案非正确、成本过高。中短期,基于内容创作及文娱生活导向的AIGC场景应用更为集中,包括文娱、传媒、电商等,长期产业升级机会可期。预计...