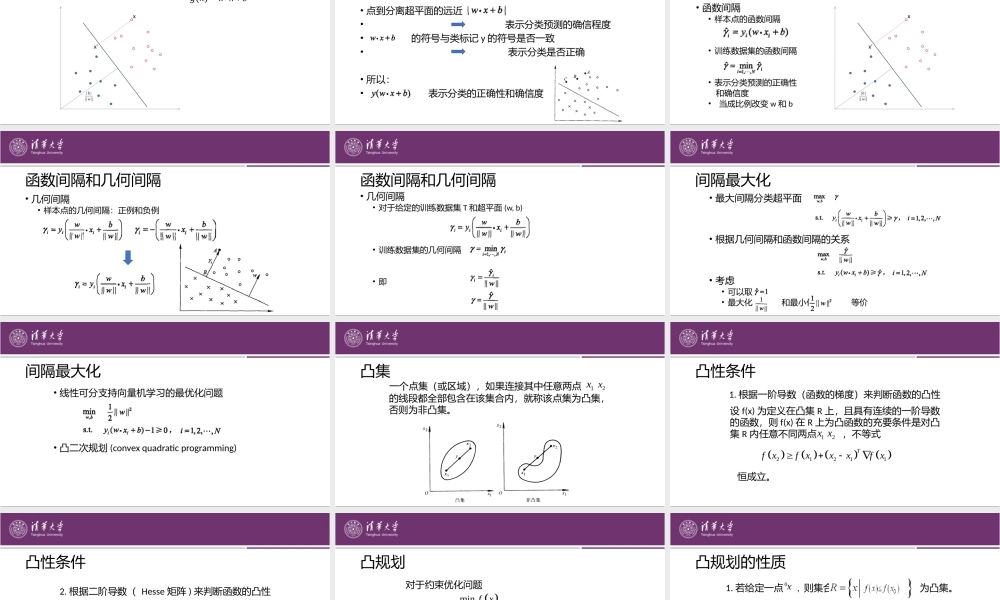

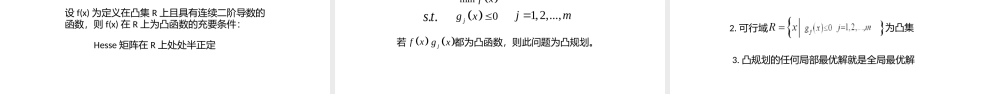

第七章SVM支持向量机SVMandVapnik•Vapnik百度•http://baike.baidu.com/link?url=VLTKJQfnwYXkT3auMUZAlEFfnVr_2GHmzA52hLcGtLXbsKo6XH4H2gDcavY4-cNKRYrHeP3r5YFEwhHKM66ncq•VapnikWiki•https://en.wikipedia.org/wiki/Vladimir_VapnikSVM•支持向量机(supportvectormachines.SVM)•二类分类模型.它的基本模型是定义在特征空间上的间隔最大的线性分类器,间隔最大使它有别于感知机;•支持向量机还包括核技巧,这使它成为实质上的非线性分类器.•支持向量机的学习策略就是间隔最大化,可形式化为一个求解凸二次规划(convexquadraticprogramming)的问题,也等价于正则化的合页损失函数的最小化问题.支持向量机的学习算法是求解凸二次规划的最优化算法.•支持向量机(supportvectormachines.SVM)•线性可分支持向量机(linearsupportvectormachineinlinearlyseparablecase).•硬间隔最大化(hardmarginmaximization);•线性支持向量机(linearsupportvectormachine)•训练数据近似线性可分时,通过软间隔最大化(softmarginmaximization);•非线性支持向量机(non-linearsupportvectormachine)•当训练数据线性不可分时,通过使用核技巧(kerneltrick)及软间隔最大化。SVM分类•支持向量机(supportvectormachines.SVM)•当输入空间为欧氏空间或离散集合、特征空间为希尔伯特空间时,核函数(kernelfunction)表示将输入从输入空间映射到特征空间得到的特征向量之间的内积;•通过使用核函数可以学习非线性支持向量机,等价于隐式地在高维的特征空间中学习线性支持向量机,这样的方法称为核技巧;•核方法(kernelmethod)是比支持向量机更为一般的机器学习方法.SVM分类•二分类问题:•输入空间:欧式空间或离散集合•特征空间:欧式空间或希尔伯特空间•线性可分支持向量机、线性支持向量机:假设这两个空间的元素一一对应,并将输入空间中的输入映射为特征空间中的特征向量;•非线性支持向量机:利用一个从输入空间到特征空间的非线性映射将输入映射为特征向量;•支持向量机的学习是在特征空间进行的.线性可分支持向量机•假设特征空间上的训练数据集:•正例和负例•学习的目标:找到分类超平面,•线性可分支持向量机:给定线性可分训练数据集,通过间隔最大化或等价地求解相应的凸二次规划问题学习得到的分离超平面为•决策函数:线性可分支持向量机w·x+b>0w·x+b<0w·x+b=0w线性可分支持向量机与硬间隔最大化?超平面选择SupportVectorsSupportVec...