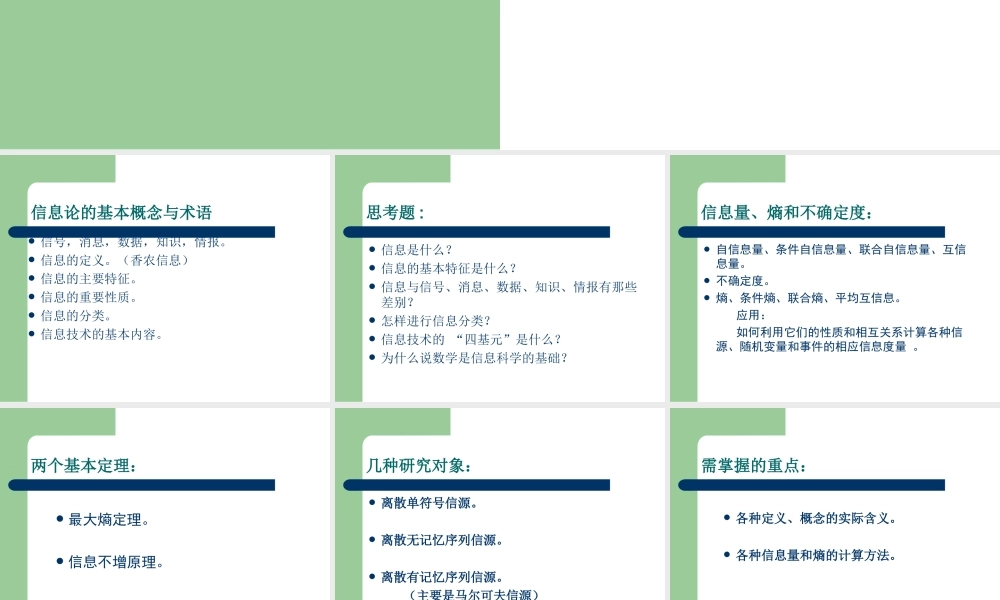

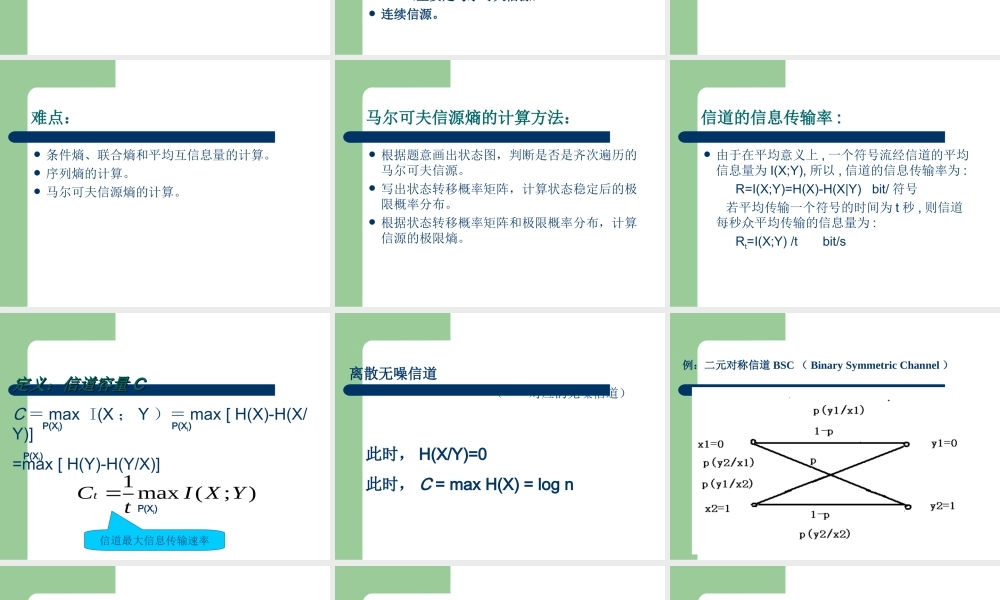

信息论课程总结信息论的基本概念与术语信号,消息,数据,知识,情报。信息的定义。(香农信息)信息的主要特征。信息的重要性质。信息的分类。信息技术的基本内容。思考题:信息是什么?信息的基本特征是什么?信息与信号、消息、数据、知识、情报有那些差别?怎样进行信息分类?信息技术的“四基元”是什么?为什么说数学是信息科学的基础?信息量、熵和不确定度:自信息量、条件自信息量、联合自信息量、互信息量。不确定度。熵、条件熵、联合熵、平均互信息。应用:如何利用它们的性质和相互关系计算各种信源、随机变量和事件的相应信息度量。两个基本定理:最大熵定理。信息不增原理。几种研究对象:离散单符号信源。离散无记忆序列信源。离散有记忆序列信源。(主要是马尔可夫信源)连续信源。需掌握的重点:各种定义、概念的实际含义。各种信息量和熵的计算方法。难点:条件熵、联合熵和平均互信息量的计算。序列熵的计算。马尔可夫信源熵的计算。马尔可夫信源熵的计算方法:根据题意画出状态图,判断是否是齐次遍历的马尔可夫信源。写出状态转移概率矩阵,计算状态稳定后的极限概率分布。根据状态转移概率矩阵和极限概率分布,计算信源的极限熵。信道的信息传输率:由于在平均意义上,一个符号流经信道的平均信息量为I(X;Y),所以,信道的信息传输率为:R=I(X;Y)=H(X)-H(X|Y)bit/符号若平均传输一个符号的时间为t秒,则信道每秒众平均传输的信息量为:Rt=I(X;Y)/tbit/s定义:信道容量定义:信道容量CCC=maxI(X;Y)=max[H(X)-H(X/Y)]=max[H(Y)-H(Y/X)]P(Xi)P(Xi)P(Xi));(max1YXItCtP(Xi)信道最大信息传输速率离散无噪信道(一一对应的无噪信道)此时,H(X/Y)=0此时,C=maxH(X)=logn例:二元对称信道BSC(BinarySymmetricChannel)BSC的信道容量为:1(/)1()1log(1)log(1)CHXYHppppp离散信道容量的一般计算办法;连续信道的信道容量。复习思考题:随机事件的不确定度和它的自信息量之间的关系及区别?单符号离散信源的数学模型,自信息量、条件自信息量、联合自信息量的含义?互信息量的性质?含义?分别从输入端、输出端和系统总体来理解互信息量的含义。各种熵(信源熵,条件熵,联合熵(共熵),等)的含义及其关系。熵的基本性质与定理及其理解?平均互信息量的定义及物理意义?疑义度及噪声熵?平均互信息量的性质及理解?最大离散熵定...