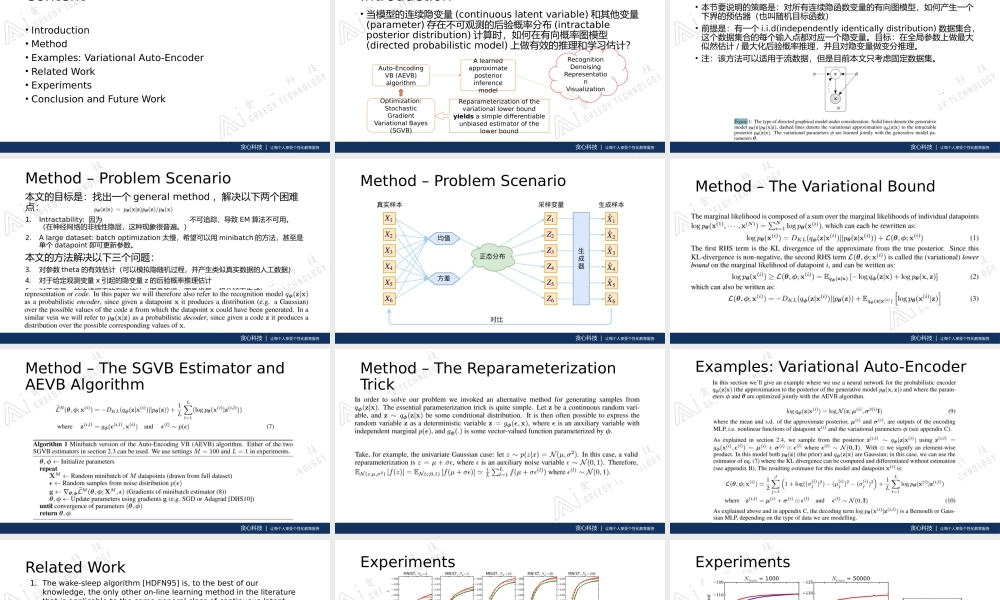

贪心科技|让每个人享受个性化教育服务Review:PaperReadingAuto-EncodingVariationalBayes范老师2020/05/31贪心科技|让每个人享受个性化教育服务Content•Introduction•Method•Examples:VariationalAuto-Encoder•RelatedWork•Experiments•ConclusionandFutureWork贪心科技|让每个人享受个性化教育服务Introduction•当模型的连续隐变量(continuouslatentvariable)和其他变量(parameter)存在不可观测的后验概率分布(intractableposteriordistribution)计算时,如何在有向概率图模型(directedprobabilisticmodel)上做有效的推理和学习估计?Auto-EncodingVB(AEVB)algorithmOptimization:StochasticGradientVariationalBayes(SGVB)AlearnedapproximateposteriorinferencemodelRecognitionDenoisingRepresentationVisualizationReparameterizationofthevariationallowerboundyieldsasimpledifferentiableunbiasedestimatorofthelowerbound贪心科技|让每个人享受个性化教育服务Method•本节要说明的策略是:对所有连续隐函数变量的有向图模型,如何产生一个下界的预估器(也叫随机目标函数)•前提是:有一个i.i.d(independentlyidenticallydistribution)数据集合,这个数据集合的每个输入点都对应一个隐变量。目标:在全局参数上做最大似然估计/最大化后验概率推理,并且对隐变量做变分推理。•注:该方法可以适用于流数据,但是目前本文只考虑固定数据集。贪心科技|让每个人享受个性化教育服务Method–ProblemScenario本文的目标是:找出一个generalmethod,解决以下两个困难点:1.Intractability:因为不可追踪,导致EM算法不可用。(在神经网络的非线性隐层,这种现象很普遍。)2.Alargedataset:batchoptimization太慢,希望可以用minibatch的方法,甚至是单个datapoint即可更新参数。本文的方法解决以下三个问题:3.对参数theta的有效估计(可以模拟隐随机过程,并产生类似真实数据的人工数据)4.对于给定观测变量x引起的隐变量z的后验概率推理估计5.对于变量x的边缘概率的有效估计(图像降噪、图像修复、超分辨率生成)贪心科技|让每个人享受个性化教育服务Method–ProblemScenario贪心科技|让每个人享受个性化教育服务Method–TheVariationalBound贪心科技|让每个人享受个性化教育服务Method–TheSGVBEstimatorandAEVBAlgorithm贪心科技|让每个人享受个性化教育服务Method–TheReparameterizationTrick贪心科技|让每个人享受个性化教育服务Exa...