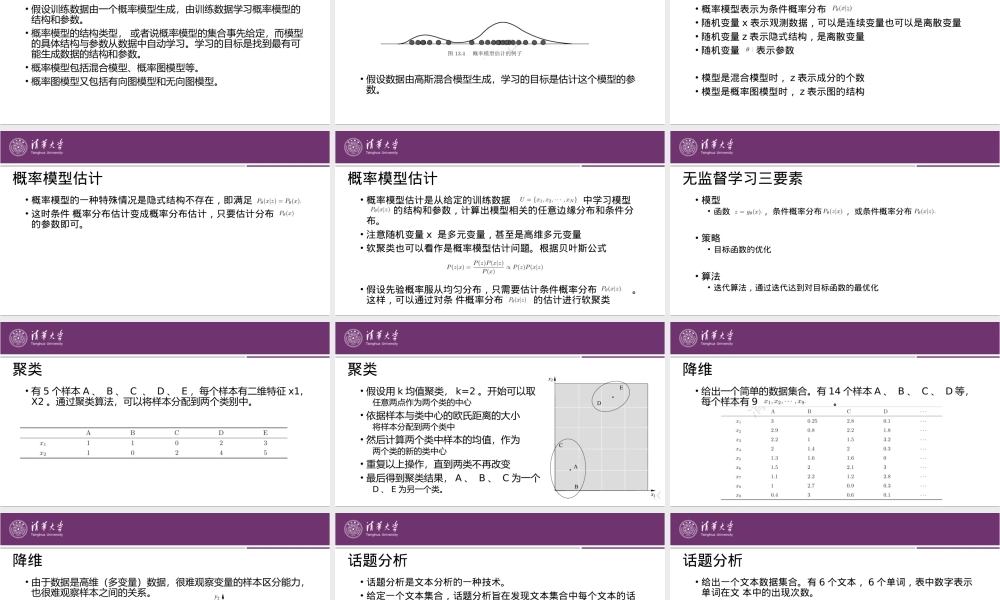

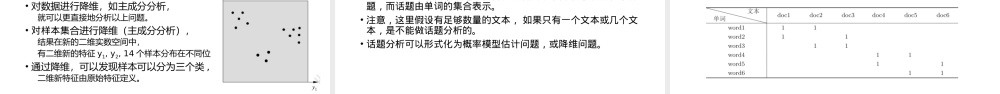

第十三章无监督学习概论无监督学习•使用无标注数据学习或训练,由特征向量组成•无监督学习的模型是函数,条件概率分布,或条件概率分布•假设训练数据集由N个样本组成,每个样本是一个M维向量。训练数据可以由一个矩阵表示,每一行对应一个特征,每一列对应一个样本无监督学习•无监督学习的基本想法是对给定数据(矩阵数据)进行某种压“缩,从而找到数据的潜在结构。假定损失最小的压缩得到的结”果就是最本质的结构。•考虑发掘数据的纵向结构,把相似的样本聚到同类,即对数据进行聚类无监督学习•无监督学习的基本想法是对给定数据(矩阵数据)进行某种压“缩,从而找到数据的潜在结构。假定损失最小的压缩得到的结”果就是最本质的结构。•考虑发掘数据的横向结构,把高维空间的向量转换为低维空间的向量,即对数据进行降维。无监督学习•无监督学习的基本想法是对给定数据(矩阵数据)进行某种压“缩,从而找到数据的潜在结构。假定损失最小的压缩得到的结”果就是最本质的结构。•同时考虑发掘数据的纵向与横向结构,假设数据由含有隐式结构的概率模型生成得到,从数据中学习该概率模型。聚类•聚类(clustering)是将样本集合中相似的样本(实例)分配到相同的类,不相似的样本分配到不同的类。•聚类时,样本通常是欧氏空间中的向量,类别不是事先给定,而是从数据中自动发现,但类别的个数通常是事先给定的。样本之间的相似度或距离由应用决定。•如果一个样本只能属于一个类,则称为硬聚类(hardclustering)•如果一个样本可以属于多个类,则称为软聚类(softclustering)聚类•硬聚类时,每一个样本属于某一类•软聚类时,每一个样本依概率属于每一个类降维•降维(dimensionalityreduction)是将训练数据中的样本(实例)从高维空间转换到低维空间。•假设样本原本存在于低维空间,或者近似地存在于低维空间,通过降维则可以更好地表示样本数据的结构,即更好地表示样本之间的关系。•高维空间通常是高维的欧氏空间,而低维空间是低维的欧氏空间或者流形(manifold)。•从高维到低维的降维中,要保证样本中的信息损失最小。降维•降维有线性的降维和非线性的降维。•二维空间的样本存在于一条直线的附近,可以将样本从二维空间转换到一维空间。通过降维可以更好地表示样本之间的关系。降维•假设输入空间是欧氏空间,输出空间也是欧氏空间,后者的维数低于前者的维数。降维的模型是函数•其中是样本的高维向量,是样本的低维向量,...