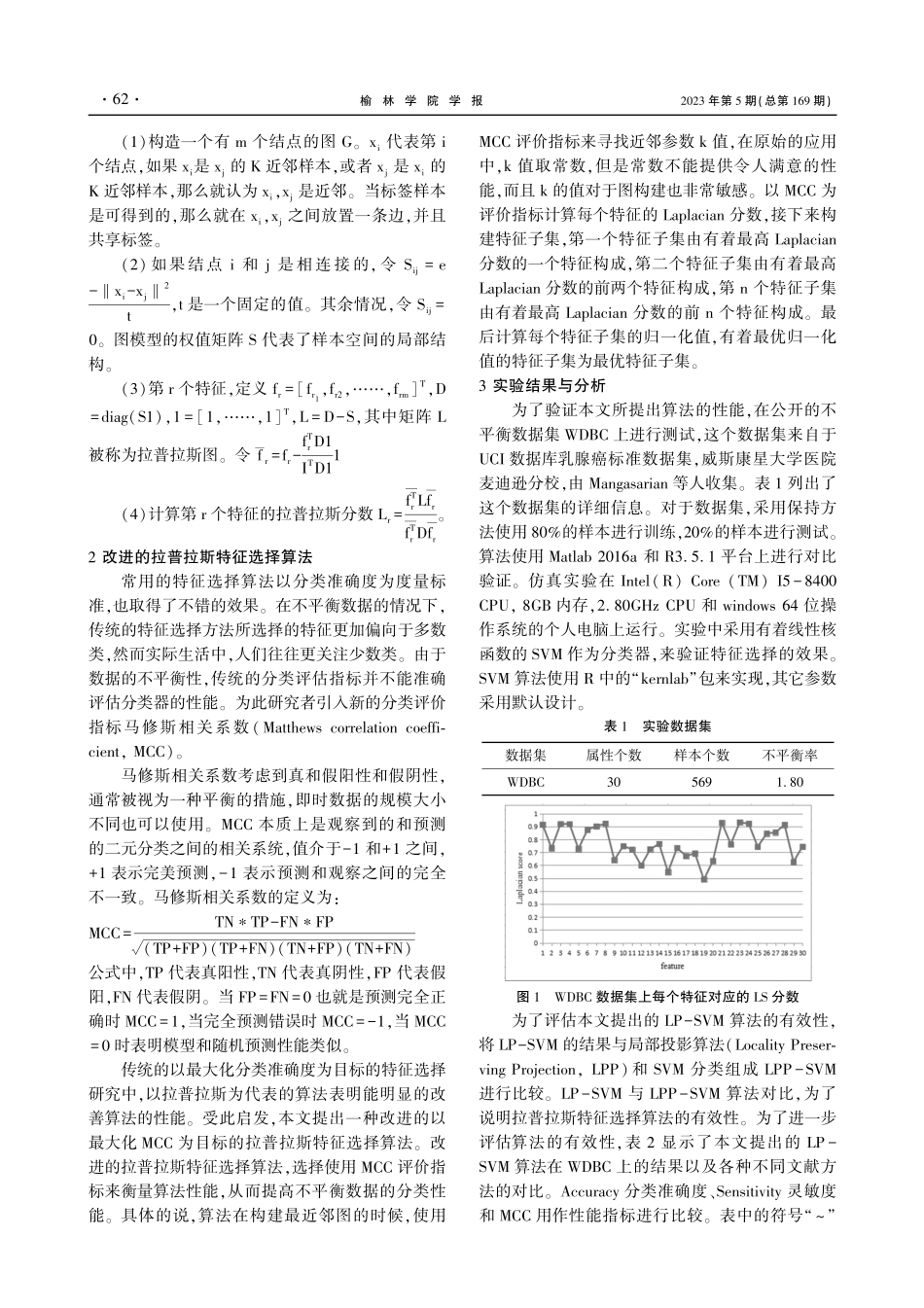

收稿日期:2022-10-08作者简介:张珏(1984—),女,陕西榆林人,副教授,博士,主要从事机器学习与模式识别研究。基金项目:国家自然科学基金资助项目(62266047);榆林市科技局产学研项目(CXY-2022-66);榆林市高新区科学计划项目(CXY-2021-30,CXY-2021-44);榆林学院博士科研启动金(22GK03)基于不平衡数据的特征选择算法研究张珏,田建学(榆林学院信息工程学院,陕西榆林719000)摘要:不平衡分类问题广泛存在于医学检测、人脸识别、异常检测等领域,研究表明对于不平衡数据分类,有效的特征选择算法至关重要。对特征选择算法Laplacian进行改进,在考虑不平衡数据分类评价指标的同时,提出基于改进的Laplacian特征选择算法,该算法首先使用Laplacian分数对特征进行评估;其次通过聚类对选择的特征进行聚类;最后通过聚类后的标签和真实的标签来计算每个特征子集的归一化信息,有着最高归一化值的特征子集即为最优特征子集。实验结果表明,本文提出的算法能有效进行不平衡数据的特征选择,在一定程度上提高了小类的分类性能。关键词:特征选择;不平衡数据;支持向量机;拉普拉斯算法中图分类号:TP309文献标志码:A文章编号:1008-3871(2023)05-0061-03DOI:10.16752/j.cnki.jylu.2023.05.015当将全部特征直接用于构建分类器,不但耗时,而且会降低分类性能。因此,需要引入特征选择方法,对原始属性进行裁剪,进而依据分类的要求筛选出最有效特征子集用于构建分类器。具体的说,引入特征选择对算法性能提升主要表现在以下四个方面:(1)经过特征选择获得的数据表达,能够增强学习模型在绝大多数实际场景中泛化能力;(2)可以有效克服由维数增加所引发的“维数灾难”和“过拟合”等问题;(3)采用降低维度后的特征构建学习模型,可以在有效提高算法的分类性能的同时降低算法的计算复杂度;(4)通过特征选择后获得的知识表达式,可以降低研究人员对问题理解和解释的难度。特征选择方法可以改进分类器预测性能,提高计算速度并减少内存开销。不平衡数据是指某一种分类的数量多余另一种分类的数量。不平衡分类问题在多个领域存在,在这些领域中,人们对少数类更感兴趣,少数类的样本也往往更具有价值。面向不平衡数据进行特征选择时,少数类的存在增大了寻找最优特征子集的难度,传统的以最大分类正确率为准则的特征选择算法往往不能选择出有效的特征子集。Ogura等[1]指出传统的特征选择算法对不平衡数据进行特征选择时的不适应性,提出应该设计是适应于不平衡数据的特征选择算法。因此,对于不平数据集分类,特征...